L’intelligenza artificiale applicata alla finanza: come le banche utilizzano l’AI

L'ultima moda sull'intelligenza artificiale sta alimentando una massiccia impennata del mercato azionario, con la scommessa che una nuova era di innovazione sia vicina.

Deutsche Bank AG utilizza l'intelligenza artificiale per analizzare i portafogli dei clienti più facoltosi. ING Group NV sta effettuando uno screening dei potenziali clienti inadempienti. Morgan Stanley dice che i suoi banker stanno "sperimentando" l’AI in un "ambiente sicuro e contenuto". Nel frattempo, JPMorgan Chase & Co. sta facendo incetta di talenti, pubblicizzando più ruoli nell'AI di tutti i suoi rivali. Dunque la rivoluzione dell'AI si sta sviluppando a Wall Street, mentre cresce l'interesse per questa tecnologia in evoluzione e per il suo possibile impatto sull’economia.

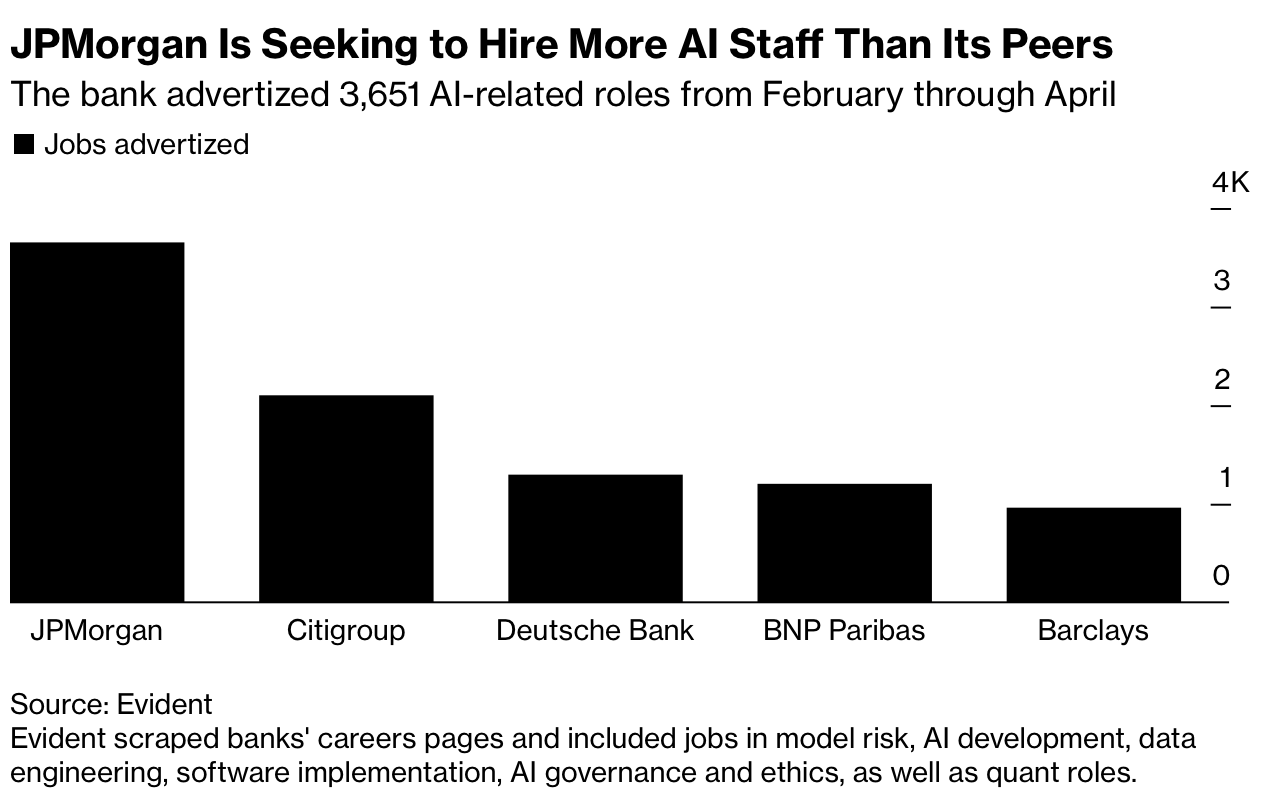

Secondo i nuovi dati della società di consulenza Evident, nelle banche più attive circa il 40% di tutte le posizioni aperte riguarda assunzioni legate all'AI e JPMorgan è in testa. La più grande banca statunitense ha pubblicato a livello globale 3.651 annunci per ruoli legati all'AI da febbraio ad aprile, quasi il doppio dei suoi rivali più vicini, Citigroup Inc. e Deutsche Bank, secondo i dati di Evident.

Eigen Technologies Ltd., che aiuta aziende come Goldman Sachs Group Inc. e ING con l'AI, ha dichiarato che le richieste delle banche sono quintuplicate nel primo trimestre del 2023 rispetto allo stesso periodo dell'anno precedente. Il rilascio di ChatGPT di Open AI nel novembre 2022 ha "reso tutti - il consiglio di amministrazione, l'amministratore delegato e la dirigenza delle banche - molto più consapevoli del fatto che si tratta di una svolta epocale", ha dichiarato Alexandra Mousavizadeh, amministratore delegato e cofondatore di Evident. "Il prezzo dei talenti sta salendo", ha detto, descrivendo la situazione come una "corsa agli armamenti dell'AI".

La prospettiva che le attività quotidiane vengano gestite in modo più efficiente ed efficace, mentre le analisi complesse e la modellazione del rischio diventino più facili e veloci è molto allettante nel settore bancario.

Come le banche stanno già utilizzando l’Intelligenza artificiale

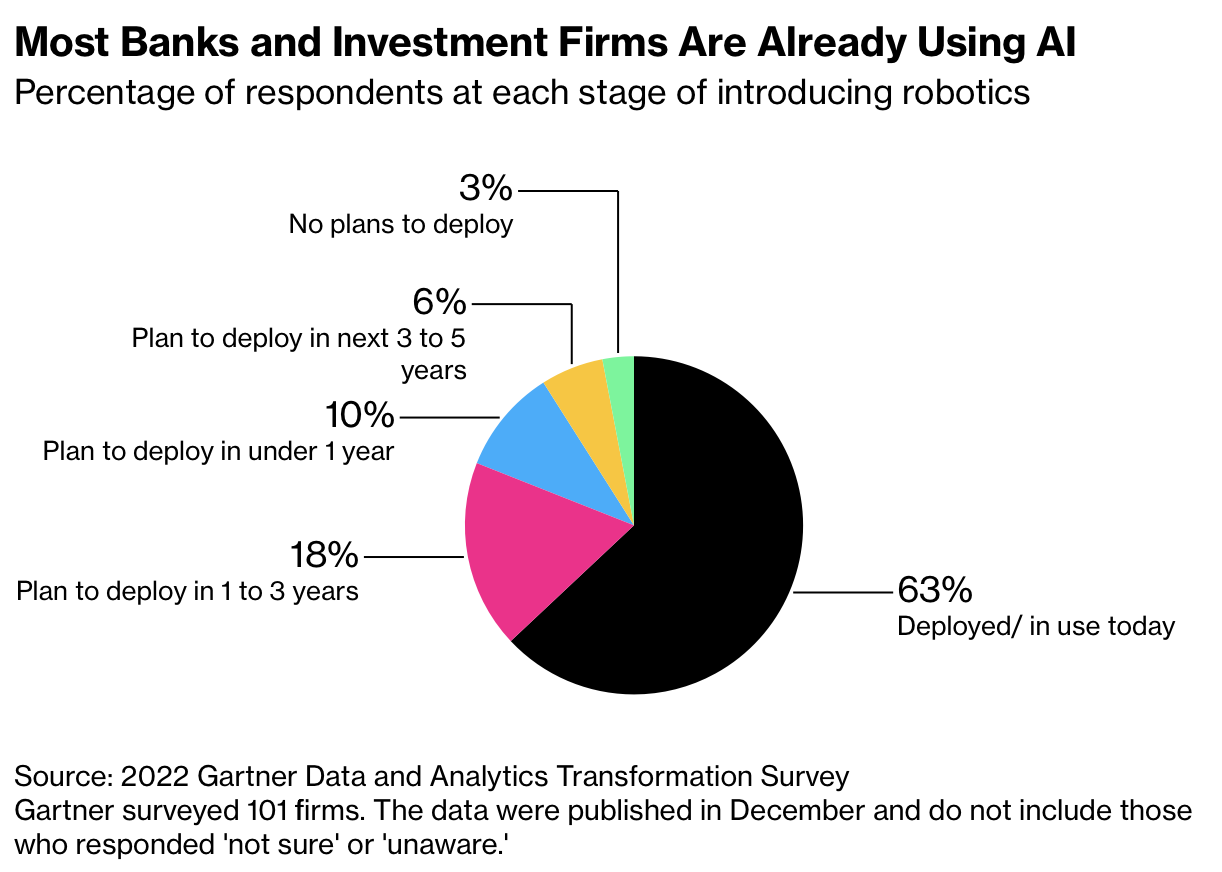

La maggior parte delle banche e delle società di investimento sta già utilizzando l'AI, come vediamo dall’indagine sulla trasformazione dei dati e delle analisi condotta da Gartner nel 2022 su 101 aziende lo scorso anno.

Deutsche Bank sta impiegando il cosiddetto deep learning per analizzare se i clienti del private banking internazionale sono troppo investiti in un particolare asset e abbinare i singoli clienti a fondi, obbligazioni o azioni. Nel rispetto della conformità normativa, i consulenti umani trasmettono poi le raccomandazioni generate dall'intelligenza artificiale, con una combinazione tra interazione umana e intelligenza artificiale.

JPMorgan ha piani simili. A maggio ha presentato una domanda di brevetto per un servizio simile a ChatGPT per aiutare gli investitori a selezionare particolari titoli azionari, il progetto è in fase iniziale.

Morgan Stanley ad aprile ha dichiarato di aver brevettato un modello che utilizza l'AI e il deep learning per interpretare se le comunicazioni della Federal Reserve sono improntate alla prudenza o alla sfiducia. L'obiettivo è individuare la direzione della politica monetaria.

Wells Fargo sta utilizzando l'analisi dei big data come supporto per determinare quali informazioni i clienti devono comunicare alle autorità di regolamentazione e come possono migliorare i loro processi aziendali. "Ci toglie un po' di lavoro ripetitivo e allo stesso tempo siamo più veloci nell'essere compliant", ha dichiarato Chintan Mehta, CIO e responsabile della tecnologia digitale e dell'innovazione dell'azienda. La banca ha anche costruito un'assistenza clienti basata su chatbot utilizzando la piattaforma di intelligenza artificiale per le conversazioni di Google Cloud, Dialogflow.

La banca francese BNP Paribas sta utilizzando i chatbot per rispondere alle domande dei clienti, mentre l'AI cerca di individuare e prevenire le frodi e il riciclaggio di denaro.

Allo stesso modo, Cast di Societe Generale utilizza la sua potenza di calcolo per analizzare eventuali comportamenti scorretti nei mercati dei capitali. La banca ha dichiarato che opera in 26 lingue per elaborare 2,5 milioni di ore di conversazione e 347 milioni di e-mail all'anno.

Gli analisti di Goldman Sachs stimano che 300 milioni di posti di lavoro a tempo pieno a livello globale potrebbero essere a rischio a causa dell'automazione dell'AI generativa, secondo un rapporto di marzo. Questo potrebbe includere il 35% del settore delle operazioni commerciali e finanziarie negli Stati Uniti.

"Le banche stanno già utilizzando l'AI per trovare soluzioni di copertura più personalizzate attraverso strumenti come gli swap sui tassi d'interesse e i derivati azionari, consentendo loro di offrire prezzi migliori ai clienti", ha dichiarato Steven Burrows, direttore di Fieldfisher LLP ed ex trader di derivati.

Per gli Asset Manager, l'era di ChatGPT ha per ora una promessa meno altisonante: l'automatizzazione del lavoro di routine, dalla revisione di risme di ricerche di mercato alla scrittura di codice di base e al riassunto delle performance dei fondi. Tuttavia, gli strumenti di AI generativa non stanno ancora cambiando i loro metodi di selezione dell'investimento che continuano quindi ad essere condotti esclusivamente dall'uomo.

Costa più un dipendente o l’intelligenza artificiale per una banca?

Anche l'AI è costosa, sia per lo sviluppo che per l'esecuzione. Secondo le stime, il costo dell'utilizzo di modelli linguistici di grandi dimensioni per rispondere a una domanda può arrivare a 14 dollari, rispetto ai 6 dollari di un avvocato, secondo Lewis Z. Liu, amministratore delegato di Eigen. Ciò è dovuto agli elevati costi di cloud computing associati alla gestione di documenti finanziari complessi.

L’intelligenza artificiale migliora il servizio offerto e l’esperienza clienti

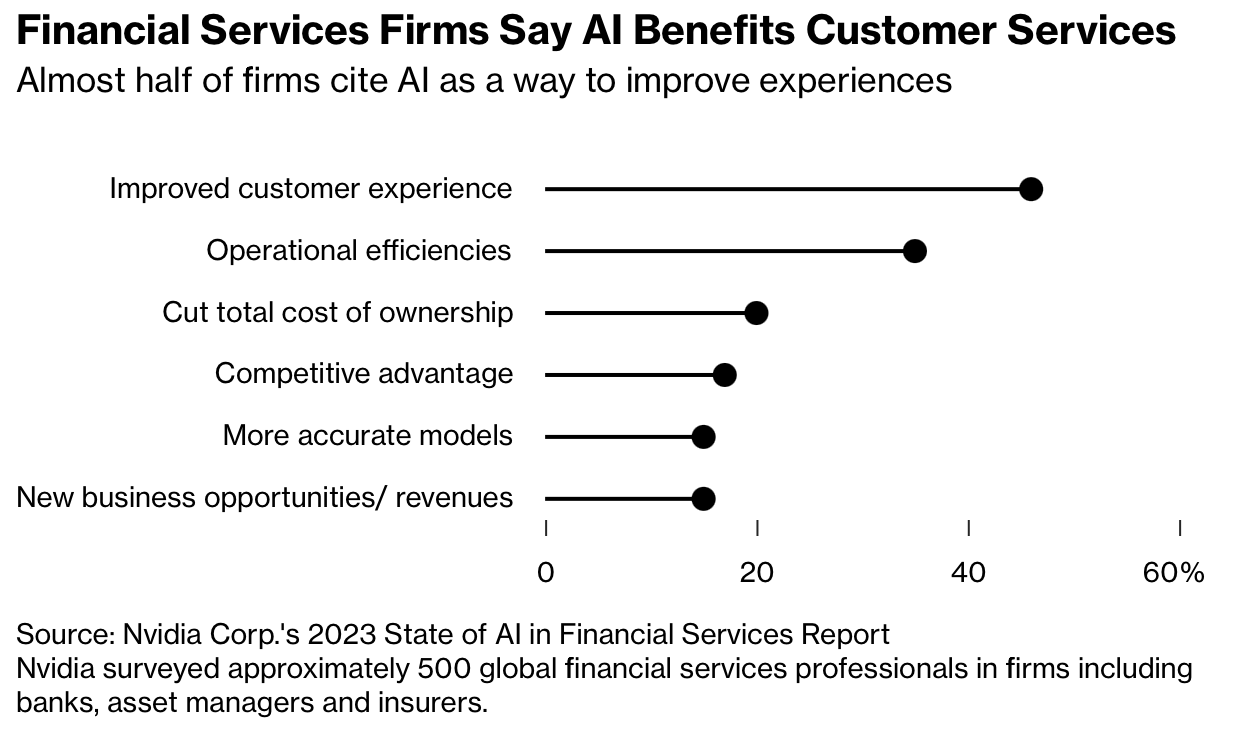

Secondo il Report 2023 sullo stato dell'AI nei servizi finanziari di Nvidia, quasi la metà delle aziende cita l'AI come mezzo per migliorare l'esperienza dei clienti. Per il report, Nvidia ha intervistato circa 500 professionisti dei servizi finanziari a livello globale in aziende che comprendono banche, gestori patrimoniali e assicurazioni.

Le perplessità sull’intelligenza artificiale: inaffidabilità e protezione dei dati

Alcuni hanno invitato alla cautela, con preoccupazioni sulla trasparenza e sull'efficacia. Molti, tra cui l'investitore miliardario Warren Buffett, vedono la smania di abbracciare sistemi complessi come l'AI un presagio di rischi futuri: "Quando qualcosa può fare ogni genere di cose, mi preoccupo perché so che non saremo in grado di farla regredire".

In aggiunta, il vero problema è attualmente l’inaffidabilità degli output delle AI. Ad esempio ChatGPT si inventa i fatti e fornisce risposte diverse allo stesso messaggio, ed è addestrato solo sui dati fino alla fine del 2021 (anche se è già in beta la versione con l'accesso a internet).

I banchieri hanno il dovere fiduciario di non operare su informazioni inaffidabili. Secondo Anne Beaumont, partner dello studio Friedman Kaplan Seiler Adelman & Robbins LLP di New York, questo è un problema che si pone con l'espandersi dell'uso dell'AI. "Come si fa a dimostrare agli investitori e alle autorità di regolamentazione di aver fatto il proprio dovere quando si utilizza un output senza conoscere realmente gli input?", ha affermato.

Alan Blackwell, professore di progettazione interdisciplinare presso il dipartimento di informatica e tecnologia dell'Università di Cambridge, ha affermato che una banca dovrebbe raccogliere informazioni da un'ampia gamma di fonti pubbliche per addestrare modelli linguistici di grandi dimensioni. "Una banca rispettabile ha davvero intenzione di dire ai suoi clienti la stessa cosa che l’AI ha trovato su Reddit?".

Oltre all’inaffidabilità il problema è anche la protezione dei dati in un settore in cui i segreti commerciali vengono custoditi con ansia, per questo molte società sono ancora titubanti nell'affidarsi a software esterni. Con lo scopo di proteggere i suoi dati l’hedge fund Campbell ha sperimentato un modello GPT open-source e meno potente che può essere eseguito interamente all'interno dei propri sistemi, ha dichiarato il CEO Cole. "Dobbiamo stare molto attenti ai rischi di perdita di proprietà intellettuale con questi tipi di strumenti, perché con ChatGPT si inviano query ai server OpenAI", ha dichiarato.

Musk e la lettera per chiedere una pausa nello sviluppo dell'intelligenza artificiale

Sicuramente Elon Musk è uno dei personaggi che ha espresso le maggiori perplessità sullo sviluppo dell'intelligenza artificiale, nonostante sia uno dei co-fondatori di OpenAi e Tesla utilizzi l'AI per il sistema di pilota automatico.Il CEO di Tesla e un gruppo di esperti di intelligenza artificiale e di dirigenti del settore a marzo hanno chieso una pausa di sei mesi nello sviluppo di sistemi più potenti di GPT-4 di OpenAI in una lettera aperta in cui si citano potenziali rischi per la società. "I potenti sistemi di AI dovrebbero essere sviluppati solo quando saremo sicuri che i loro effetti saranno positivi e i loro rischi gestibili", si legge nella lettera pubblicata dal Future of Life Institute, un organizzazione no-profit che vede tra i suoi maggiori finanziatori la Musk Foundation e la Silicon Valley Community Foundation. Tra i cofirmatari figurano l'amministratore delegato di Stability AI Emad Mostaque, i ricercatori di DeepMind, società di proprietà di Alphabet, e i pesi massimi dell'IA Yoshua Bengio, spesso definito uno dei "padrini dell'IA", e Stuart Russell, un pioniere della ricerca in questo campo. La lettera è stata firmata da oltre mille esperti."Dobbiamo lasciare che le macchine inondino i nostri canali di informazione con propaganda e falsità? ... Dovremmo sviluppare menti non umane che alla fine potrebbero essere più numerose, più intelligenti e sostituirci?", ci si chiede nella lettera, secondo cui "tali decisioni non devono essere delegate a leader tecnologici non eletti". E propone: "I laboratori di IA e gli esperti indipendenti dovrebbero utilizzare questa pausa per sviluppare e implementare congiuntamente una serie di protocolli di sicurezza condivisi per la progettazione e lo sviluppo di IA avanzate, rigorosamente controllati e supervisionati da esperti esterni indipendenti".Altman ha riposto alla lettera ad un evento al MIT: "Sono anche d'accordo sul fatto che, man mano che le capacità diventano sempre più serie, l'asticella della sicurezza deve aumentare. Penso che muoversi con cautela e con un crescente rigore per le questioni di sicurezza sia davvero importante. Non credo che la lettera fosse il modo migliore per affrontare la questione".Gary Marcus, professore della New York University, ha detto a Reuters: "La lettera non è perfetta, ma lo spirito è giusto: dobbiamo rallentare fino a quando non avremo compreso meglio le ramificazioni. I grandi operatori stanno diventando sempre più riservati su ciò che stanno facendo, il che rende difficile per la società difendersi da qualsiasi danno possa materializzarsi"."Gran parte del potere di sviluppare questi sistemi è stato costantemente nelle mani di poche aziende che hanno le risorse per farlo. Questi modelli sono così, difficili da costruire e da democratizzare.", ha detto Suresh Venkatasubramanian, professore alla Brown University ed ex assistente del direttore dell'Ufficio della politica scientifica e tecnologica della Casa Bianca.La regolamentazione dell'AI: Chat GPT e il "ricatto"

ChatGPT per iPhone, lanciato all'inizio dello scorso mese negli Stati Uniti, è arrivato nel Regno Unito, in Francia, in Germania e in altri otto Paesi. È diventata quasi subito l'app di produttività più scaricata nello store di Apple. In un sondaggio condotto da Deutsche Bank AG su 1.150 dipendenti di diversi settori, ad aprile il 44% dei lavoratori statunitensi ha dichiarato che ChatGPT veniva utilizzato, anche se solo provvisoriamente, nel proprio posto di lavoro e il 22% ha affermato che l'uso di ChatGPT era già "intenso"; nel Regno Unito, il 14% degli intervistati ha dichiarato lo stesso.

Se questa straordinaria tecnologia venisse improvvisamente disattivata domani, avrebbe già delle ramificazioni significative. Il potenziale impulso economico globale di 15.700 miliardi di dollari, stimato da McKinsey, verrebbe rallentato. Il valore degli investimenti nell'IA, che sono stati effettuati per miliardi, verrebbe messo in discussione. Ecco perché i recenti commenti di Altman sono così allarmanti: quando gli è stato chiesto il suo punto di vista sulla proposta di legge sull'IA della Commissione Europea, il primo importante atto legislativo sull'IA in discussione, ha detto ai giornalisti che la sua azienda "cercherà di conformarsi" ma se non ci fosse riuscito, OpenAI avrebbe "cessato di operare" sul mercato. In seguito ha fatto marcia indietro, scrivendo su Twitter che l'azienda non ha "intenzione di lasciare" l'Europa, il che è probabilmente vero - la legge non sarà probabilmente finalizzata fino al prossimo anno ma la minaccia era chiara.

Il commissario europeo Thierry Breton, anch'egli ex amministratore delegato del settore tecnologico, ha definito i commenti di Altman "un ricatto", aggiungendo: "Le nostre regole sono state messe in atto per la sicurezza e il benessere dei nostri cittadini e questo non può essere oggetto di contrattazione".

In effetti il metodo del "ricatto" non è nuovo nel mondo tecnologico: le società cercano di raggiungere una massa critica di utenti per "dettare legge". Ad esempio Uber la settimana scorsa ha promosso con successo il veto per una legge in Minnesota, affermando che si sarebbe ritirata dallo Stato se costretta a offrire un salario minimo. Airbnb tira in ballo i proprietari di case che faticano a sbarcare il lunario ogni volta che le normative minacciano di disturbare l'home-sharing. Meta Platforms avverte che ritirerà l'app di messaggistica WhatsApp dal Regno Unito a causa di una legge sulla sicurezza online. TikTok sa che la migliore possibilità di evitare un divieto negli Stati Uniti è quella di sfruttare l'esercito di utenti della Gen Z che non riescono a concepire la vita senza di essa.Una difesa della resistenza delle aziende tecnologiche alla regolamentazione è che loro sono gli esperti e i legislatori non lo sono. "Non c'è modo che un non addetto ai lavori possa capire cosa è possibile fare", ha detto di recente l'ex presidente di Google Eric Schmidt. Le nuove proposte di legge, per quanto benintenzionate, potrebbero essere negative e rischiano di essere approvate troppo in fretta.

Glossario: i termini dell’intelligenza artificiale

L’intelligenza artificiale riferisce all'uso della tecnologia per modellare l'intelligenza umana. L'IA promette un mondo di prodotti e notizie personalizzate e servizi più economici, più veloci e privi di errori umani. Sebbene l'IA possa mostrare capacità simili a quelle umane nell'elaborazione dei dati o nelle conversazioni, le macchine non "capiscono" ancora cosa stanno facendo o dicendo. Si affidano ancora essenzialmente agli algoritmi.

Il termine Intelligenza Artificiale Generativa si riferisce alla produzione di opere creative - immagini, musica, testi, poesie, canti di mare - a partire da semplici richieste. Questo tipo di sistemi non va confuso con l'IA utilizzata da aziende come Adobe nel suo prodotto Photoshop, ad esempio, che aiuta le persone a correggere o migliorare le immagini esistenti: l'IA generativa crea lavori completamente nuovi dopo essere stata addestrata su grandi quantità di materiale preesistente, cosa che sta anche generando cause legali da parte di artisti e agenzie.

Quando si parla di “reti neurali” si intende un tipo di IA in cui un computer è programmato per apprendere più o meno nello stesso modo in cui lo fa il cervello umano: per tentativi ed errori. Ogni successo o fallimento rafforza i tentativi e gli adattamenti futuri. Proprio come il cervello di un bambino impara a mappare i percorsi neurali in base a ciò che gli è stato insegnato, i "neuroni" virtuali imparano a generare risposte in base alle informazioni che gli sono state fornite e a ciò che gli viene detto che è corretto, anche se possono essere necessari migliaia o addirittura milioni di tentativi per diventare abili.

Per “Modelli linguistici di grandi dimensioni” si intendono reti neurali molto grandi che vengono addestrate utilizzando quantità massicce di testo in una particolare lingua proveniente da tutto il web, compresi e-book, articoli di notizie e pagine di Wikipedia. Con miliardi di parametri da cui apprendere, i modelli linguistici di grandi dimensioni sono la spina dorsale dell'elaborazione del linguaggio naturale, in grado di riconoscere, riassumere, tradurre, prevedere e generare testo. Forse l'LLM più noto è GPT-3, il motore di ChatGPT.

“GPT” significa Generative Pre-trained Transformer. È un tipo di modello linguistico di grandi dimensioni in grado di prendere stringhe di input e di elaborarle tutte insieme, anziché isolatamente, in modo da catturare il contesto e l'ordine delle parole. Si tratta di un modello particolarmente utile nelle traduzioni. Il termine non è specifico del creatore di ChatGPT, OpenAI ma in effetti, è stato coniato da Google.

Investire nell'intelligenza artificiale

Abbiamo parlato di come investire nell'intelligenza artificiale in tutti gli ultimi webinar. In particolare nell'ultimo webinar abbiamo visto come sia fondamentale puntare sulle grandi aziende piuttosto che sulle piccole per diversi motivi tra cui le forti barriere all'ingresso date dal capitale necessario per sviluppare e mantenere l'IA (il business è capital intensive) e la necessità di relazioni industriali consolidate con partner in grado di supportare nello sviluppo, mantenimento e crescita dell'IA.Considerando il forte rally dei titoli non è saggio investire a rally "maturo" tuttavia potrebbe non essere saggio neanche aspettare la correzione perchè non è detto che si verifichi nel breve. Infatti, come abbiamo visto sul canale FreeFinance PRO, Wells Fargo pensa che il settore tech non scenderà fin quando la FED non diventerà più aggressiva e si avrà una recessione importante. Questa è una view condivisa anche da altri analisti. In più c'è da considerare che molti investitori istituzionali sono stati lasciati fuori nel rally iniziale quindi effettivamente per loro è ancora troppo presto uscire con una performance non proprio sufficiente e sicuramente preferiscono puntare su azioni in crescita, stabili e capitalizzate in un contesto di incertezza. In altre parole sarebbe strano vedere forti rivendite nel breve su questi titoli, a meno che queste non siano innescate da elementi macro rilevanti (FED aggressiva, recessione, instabilità geopolitica). Nel webinar del giovedì parleremo di questi temi analizzando anche i flussi degli investitori delle ultime settimane e cercando di capire i diversi scenari possibili per i prossimi mesi.Considerando questi elementi potrebbe aver senso continuare ad investire ma, piuttosto che con le azioni o altri strumenti rialzisti, con i certificati perchè il contesto che si prospetta nel prossimo futuro per il settore è di lateralità (lo scenario migliore per investire in un certificato di investimento).Personalmente ho già investito nel settore tech e sui big player dell'IA prima che partisse il trend e in allocazione tattica una volta partito il trend (tutte le operazioni sui certificati le ho come sempre segnalate sui miei canali telegram) con ottimi risultati. Dunque ho fatto una ricerca aggiornata per capire se ci fossero nuovi certificati degni di nota per aumentare l'esposizione o semplicemente per applicare la tecnica dello "switch to improve". Nella ricerca, effettuata sempre tramite CedLab PRO, mi sono concentrata su tutti i certificati con premio periodico presenti sul mercato sui seguenti worst-of: Google, Microsoft, Amazon, Apple, Meta, NVIDIA e Palantir. Alle big tech ho aggiunto Palantir perchè è un player interessante a mio personalissimo parere (nonostante non faccia parte delle big tech anche per una questione di capitalizzazione) perchè in grado di sviluppare soluzioni anche in ambito bellico oltre che in ambito aziendale e può sfruttare il suo attuale parco clienti per fare cross-selling nel momento in cui vorrà vendere l'IA.Considerando il forte rally da inizio anno di queste azioni, ho eliminato tutti i certificati con un buffer da barriera inferiore al 30%. Ho eliminato anche i certificati con premio semestrale o annuale, considerando che hanno una minore stabilità di prezzo. Ho eliminato i certificati contenenti Coinbase (che hanno un rendimento inferiore rispetto al DE000VV77B47, certificato su single stock Coinbase dal 36% annuo).Purtroppo non è possibile fare una selezione di certificati interessanti, in effetti con il rally delle ultime settimane e la volatilità bassa, la maggior parte dei certificati sono ampiamente sopra la pari e presentano un rendimento residuo irrisorio. Le nuove emissioni non hanno rendimenti interessanti se comparate a quelle di qualche settimana fa. E' forse la prima volta negli ultimi anni che non trovo quasi niente di interessante sulle big tech. Sui sottostanti più difensivi i rendimenti non sono allettanti (un 10-12% p.a. si può facilmente ottenere con sottostanti meno volatili sui certificati "rimasti indietro") e i basket con maggiore rendimento sono quelli che contengono altri sottostanti volatili (come Tesla ad esempio) ma non offrono un rendimento extra significativo rispetto ad un certificato costruito solo su quel sottostante quindi non ha senso prendersi un rischio in più senza avere un rendimento aggiuntivo significativo. Si trovano certificati costruiti su "meme stock" come C3.AI, una società "piccola" con market cap inferiore a 4 miliardi, diventata nota perchè il nome contiene la parola "AI". In tal caso anche se il sottostante può essere sopra strike al momento potrebbe facilmente diventare il worst-of data la scarsa capitalizzazione di mercato e la forte performance da inizio anno (oltre +200%). Considerando anche il ragionamento dell'ultimo webinar che fanno la maggior parte degli investitori istituzionali e gli analisti, conviene concentrare la liquidità sulle big tech e per il momento ignorare azioni di tendenza che potrebbero presentare dei rischi importanti nel caso del tanto atteso sell-off dei mercati e che non pagano rendimenti stellari.Tra le recenti emissioni, l'unico certificato con un buon connubio rischio-rendimento tra quelli sul mercato (premio elevato e prezzo sotto la pari) è il DE000VU8PVW9. Si tratta di un Memory Cash Collect di Vontobel su Meta, NVIDIA e Palantir con barriera premio e capitale al 50%, barriera autocall al 100% (autocall attiva da settembre) e premio di 1,75 euro al mese (21% p.a.). Scade a dicembre 2024. Al momento Palantir e NVIDIA sono leggermente sotto strike (rispettivamente -3% e -4%) e Meta è il best-of sullo strike. Prezzo di acquisto attuale: 99,6 euro.Condividi su

Informazioni sull'autore

Ti è piaciuto l'articolo?

Non perderti neanche un contenuto, iscriviti subito alla newsletter gratuita di FreeFinance!

Iscriviti alla newsletterArticolo completo su FreeFinance Pro

L'articolo completo è disponibile su FreeFinance Pro, che richiede la registrazione gratuita. Proseguendo, verrai reindirizzato alla pagina dell'articolo sulla piattaforma FreeFinance Pro.